IA Ética: Riscos, Limites e Boas Práticas

A ética na Inteligência Artificial (IA) é central para garantir que sistemas automatizados respeitem direitos humanos, evitem vieses e atuem com transparência e responsabilidade. Este conteúdo explora os principais riscos da IA — viés algorítmico, falta de explicabilidade, ameaças à privacidade e riscos de segurança — e apresenta limites práticos, políticas e boas práticas para mitigar danos e garantir conformidade regulatória. Voltado para desenvolvedores, gestores e decisores, o guia aborda governança de IA, auditoria de modelos, avaliação de impacto, estratégias de mitigação de viés e recomendações para implementação responsável. Inclui exemplos reais, frameworks de compliance e passos acionáveis para integrar princípios éticos no ciclo de vida do produto.

IA INTELIGENTE

8/21/2025

IA Ética: Compreendendo Riscos e Limites

Introdução

E aí, tudo certo? Hoje o papo é sério e muito atual: inteligência artificial, ou simplesmente IA. Você já parou pra pensar como essa tecnologia tá presente em praticamente tudo na sua vida? É, não dá pra negar que a IA veio pra ficar. Mas, com ela, aparecem uns desafios que a gente precisa discutir.

Olha, você sabia que a previsão é que os investimentos em IA cheguem a mais de $500 bilhões em 2024? Isso mostra o quanto essa tecnologia é promissora, mas também levanta algumas questões. Como podemos ter certeza de que a IA é usada de forma ética e responsável? Vamos juntos explorar os riscos e limites dessa tecnologia que não para de evoluir.

O Que É IA Ética?

O Conceito

Vamos começar do começo. Quando falamos em IA ética, estamos nos referindo ao uso consciente dessa tecnologia. Basicamente, é garantir que a IA respeite valores humanitários e proceda de maneira justa. Afinal, a tecnologia deve estar a serviço da sociedade, né?

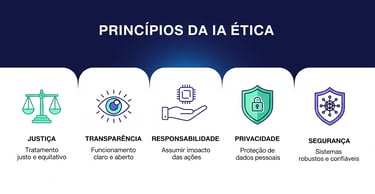

Princípios Chaves

Então, quais são os pilares que sustentam essa ética toda? Vem comigo que eu te mostro:

Justiça: Imagina que a IA seja um juiz imparcial, sem preferências. É fundamental que os dados usados sejam variados, garantindo oportunidades iguais pra todo mundo.

Transparência: Esse aqui é crucial! Se a IA decide algo importante, você precisa saber como e por que isso aconteceu. Não dá pra ficar na escuridão, né?

Responsabilidade: Quem paga o pato se a IA erra? É aí que as coisas começam a ficar nebulosas. Precisamos saber quem vai assumir as consequências quando acontece um erro.

Privacidade: Os nossos dados são preciosos, como um segredo guardado a sete chaves! A IA precisa respeitar isso e garantir que você tenha controle sobre o que rola com suas informações pessoais.

Segurança: A IA deve ser uma espécie de escudo, protegendo a gente de ameaças e garantindo um ambiente seguro.

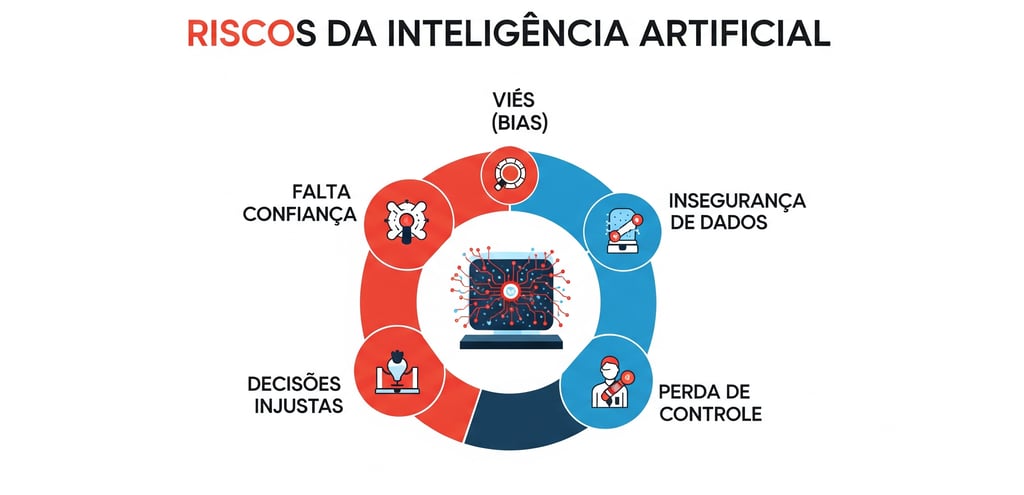

Riscos Associados ao Uso de IA

O Que Pode Dar Errado?

Como tudo na vida, a IA não tá isenta de problemas. Um dos maiores riscos é o viés nos dados. Olha, tudo que um algoritmo "aprende" vem dos dados que recebe. Se esses dados forem tendenciosos, a IA também será. Confuso, né?

Exemplos de Viés

Deixa eu te contar alguns casos que exemplificam isso:

Recrutamento: Em 2018, uma empresa teve que descartar um algoritmo de seleção de currículos porque ele favorecia homens e rejeitava mulheres de forma desigual. Que baita erro, não é?

Justiça Criminal: Um estudo de 2016 mostrou que um software de previsões de risco classificava réus negros como mais propensos a reincidir, mesmo com históricos similares. Isso é inaceitável!

Saúde: No campo da saúde, algoritmos têm demonstrado subestimar a necessidade de cuidados em populações minoritárias, resultando em diagnósticos atrasados. Imagina as consequências disso?

Consequências do Viés

Você deve estar pensando: "E qual o impacto disso tudo?" Pois vamos lá:

Perdas de Oportunidades: Situações injustas podem excluir mulheres de boas oportunidades de trabalho ou limitar acesso a serviços de saúde a grupos específicos. Isso é barbear a vida das pessoas!

Erosão da Confiança: Quando a galera descobre que a tecnologia não é justa, a confiança despenca. E não se trata só da IA, mas também das instituições que a utilizam.

Portanto, é vital que os desenvolvedores estejam cientes dos impactos do viés e que trabalhem ativamente para evitá-lo. E não esqueça: ter equipes variadas na hora de desenvolver essas tecnologias faz toda a diferença!

Falta de Transparência

O Problema da “Caixa Preta”

Vamos falar agora sobre um elefante na sala: a falta de transparência. Muitas vezes a IA funciona como uma "caixa preta". Você sabe o que entra e o que sai, mas o que acontece no meio, ah, isso é um mistério!

E os Efeitos?

Desconfiança do Público

Essa falta de clareza gera desconfiança. Imagina só: um algoritmo decide se você deve receber um empréstimo e você não tem ideia de como isso foi decidido. É frustrante! Um estudo da Harvard revelou que 68% das pessoas não confiam em decisões automatizadas da IA. E com razão!

Dificuldades em Atribuir Responsabilidade

Se ninguém sabe como a IA chegou a uma conclusão, como vamos responsabilizar alguém por um erro? Muitas vezes, a legislação não consegue acompanhar a evolução da tecnologia e isso gera um vácuo preocupante.

Soluções Potenciais

Modelos Explicativos

A boa notícia é que já estão saindo iniciativas pra desenvolver modelos que consigam explicar como a IA chegou a determinadas conclusões. O conceito de IA Explicável (XAI) tá em alta e pode nos ajudar a entender tudo melhor.

Auditorias de Algoritmos

Fazer auditorias regulares é essencial. Essas auditorias precisam analisar não só a eficácia dos algoritmos, mas também suas implicações éticas. Isso deve ser uma prática comum e não uma exceção.

Impacto na Privacidade

Coleta de Dados e Monitoramento

Agora, vamos ao ponto crucial: a coleta de dados. A presença da IA trouxe uma onda de coletar informações pessoais de maneiras que a gente normalmente não imagina. Preocupa, né?

Casos em Foco

Assistentes Virtuais: Dispositivos como Alexa e Siri estão sempre ouvindo. Eles coletam dados pra melhorar a experiência, mas você já parou pra pensar em quantas informações pessoais estão sendo capturadas?

Vigilância em Massa: Tecnologias de reconhecimento facial têm sido amplamente utilizadas, mas também criam um clima de preocupação em relação à privacidade individual.

Medidas para Proteger a Privacidade

Consentimento Claro

É fundamental que a gente tenha controle total sobre os dados que compartilha. Consentimento deve ser algo claro e acessível, não um emaranhado de termos que ninguém consegue entender.

Legislação Rigorosa

Leis como o GDPR e a LGPD surgem exatamente pra isso: proteger a privacidade do usuário e garantir que nossos dados tenham segurança. Essas leis estão aqui pra ajudar!

Autonomia e Controle Humano

O Dilema da Automação

Com a IA assumindo várias decisões, fica a pergunta: e a nossa autonomia? A gente vai deixar que máquinas decidam por nós? Isso gera algumas reflexões.

Exemplos de Automação

Veículos Autônomos: Carros que se dirigem sozinhos prometem revolucionar o trânsito. Mas já pensou numa situação crítica? Como uma máquina programaria a melhor ação? É uma preocupação!

Decisões em Saúde: A utilização da IA pra recomendações médicas é incrível, mas se um algoritmo não levar em conta o histórico específico de um paciente, o resultado pode ser desastroso.

A Necessidade de Supervisão Humana

Embora a IA seja eficiente, a supervisão humana é imprescindível. A ideia é que haja sempre a possibilidade de intervenção em decisões importantes. Só um humano pode captar toda a nuances de uma situação!

A Questão da Responsabilidade

Quem é o Responsável?

À medida que a IA toma decisões importantes, é fundamental discutirmos a responsabilidade. Quando algo sai errado, é necessário saber quem deve arcar com as consequências.

Cenários de Responsabilidade

Decisões Automatizadas: Se um sistema de IA toma uma decisão equivocada em um processo seletivo, a dúvida fica: quem é o responsável? O desenvolvedor, a empresa, ou o próprio algoritmo?

Danos Causados por Veículos Autônomos: No caso de um carro autônomo que se envolve em um acidente, as regras sobre responsabilidade são ainda muito vagas. Precisamos de clareza nessa área.

Propostas de Resolução

Diretrizes de Responsabilidade

Estabelecer diretrizes claras pode ajudar muito. Vamos falar de "responsabilidade compartilhada"? Isso pode ser uma solução interessante, onde tanto o fabricante quanto o usuário têm que assumir parte da responsabilidade.

Seguros Específicos

Imagina desenvolver seguros focados em IA, que garantam apoio às partes envolvidas na ocorrência de falhas. Isso poderia ser um passo enorme na direção certa.

Limites Éticos no Uso da IA

Por Que Definir Limites?

Precisamos urgentemente de limites éticos. Isso não serve apenas pra proteger os indivíduos, mas também pra construir e manter a confiança na tecnologia.

Áreas Críticas em Foco

Uso Militar: O uso de IA em armamentos levanta questões éticas sérias. Um estudo da ONU já apontou que sistemas autônomos poderiam desumanizar conflitos armados.

Manipulação e Fake News: A capacidade da IA de criar deepfakes é preocupante, pois isso pode levar à propagação de desinformação, especialmente em contextos eleitorais.

O Papel da Regulação

Consenso Mundial

Criar um consenso internacional em torno dos limites éticos da IA é fundamental pra prevenções de abusos. Organizações devem se unir pra garantir a proteção dos direitos humanos através de diretrizes sólidas.

Iniciativas Conjuntas

A colaboração entre governos, empresas e ONGs é chave. Iniciativas como o AI for Good Global Summit são ótimos exemplos de como reunir líderes para discutir o uso ético da inteligência artificial.

Conclusão

E aí, o que você acha de tudo isso? A inteligência artificial pode ser uma aliada potente na transformação da sociedade, oferecendo soluções inovadoras e práticas que facilitam o nosso dia a dia. Contudo, é inegável que os desafios que a acompanham são igualmente significativos.

Neste bate-papo, analisamos como a IA pode ser ética e responsável, mas também levantamos questões cruciais sobre viés, transparência, privacidade e responsabilidade. À medida que a tecnologia avança, é essencial que a gente mantenha um olhar crítico e atento, garantindo que suas aplicações respeitem os direitos de todos.

Lembre-se: a questão não é se devemos adotar a IA, mas como podemos utilizá-la de maneira a promover um bem-estar coletivo, ao invés de transformar a tecnologia em uma ameaça. Precisamos de mais diálogo, colaboração e regulamentações que protejam os direitos humanos enquanto potencializam os benefícios da inovação.

Que tal levar essa reflexão adiante? Compartilhe o que você pensa sobre o uso ético da IA e como podemos, juntos, construir um futuro onde a tecnologia trabalhe a nosso favor. Estou aqui pra continuar essa conversa e garantir que a gente não só entenda as mudanças que estão por vir, mas que também façamos parte delas de forma ativa e consciente. Vamos em frente?

🚀 A revolução da Inteligência Artificial já começou. A pergunta é: você vai acompanhar ou ficar para trás?

👉 O que é Inteligência Artificial? Guia Completo

https://portallaercio.com.br/o-que-e-inteligencia-artificial-guia-completo

💼 Inteligência Artificial para Negócios: 7 Aplicações que Dão Lucro em 2026

https://portallaercio.com.br/ia-negocios-lucro-2026

⚙️ IA nos Sistemas Operacionais: Como a Inteligência Artificial Aumenta sua Produtividade

https://portallaercio.com.br/ia-sistemas-operacionais-produtividade

✨ Clique, aprenda e posicione-se entre os que vão liderar o futuro.

Olá! Eu sou Laercio, criador do blog PortalLaercio.com.br — seu ponto de referência para tudo sobre tecnologia, inovação e tendências digitais. Obrigado por ler até o final deste artigo. Continue explorando nosso conteúdo exclusivo para se manter atualizado e aproveitar o melhor do mundo tecnológico.

PORTAL LAERCIO

Seu portal de tecnologia, inovação e tendências digitais

Categorias

INSTITUCIONAL

siga-nos

© 2025. Todos os direitos reservados.